Propagación hacia adelante (Forward Propagation)

Propagación hacia adelante (forward propagation).

Una red neuronal artificial calcula una salida.

A partir de una entrada.

Pasando la información a través de sus capas.

Activaciones hasta obtener un resultado final.

Es la fase en la que la red predice valores.

Antes de aplicar un proceso de corrección.

Mediante backpropagation.

¿Cómo funciona la Propagación hacia Adelante?

El proceso de forward propagation

En una red neuronal sigue estos pasos.

Entrada de datos

Se introduce un vector de características X

En la capa de entrada.

Multiplicación de pesos

Se multiplican las entradas.

Por los pesos de cada conexión.

Suma con el sesgo (bias)

Se agrega un término de sesgo.

Para cada neurona.

Aplicación de función de activación

Se transforma la salida de cada neurona.

Con una función como ReLU, Sigmoide, tanh.

Propagación a la siguiente capa

Los valores obtenidos se envían.

Entrada a la siguiente capa de la red.

Cálculo de la salida

En la última capa.

Se obtiene la predicción final de la red.

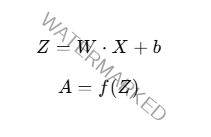

Matemáticamente si tenemos una capa con pesos W

bias b y función de activación f

La salida de una neurona se calcula.

Donde:

X es la entrada.

W es la matriz de pesos.

b es el sesgo.

Z es la combinación lineal de pesos y entradas.

A es la activación después de aplicar f(Z)

Ejemplo Práctico en Python con NumPy

Propagación hacia adelante en una red neuronal simple.

Con una capa oculta y una de salida.

import numpy as np

# Función de activación sigmoide

def sigmoid(x):

return 1 / (1 + np.exp(-x))

# Datos de entrada (X)

X = np.array([[0.5, 0.2]]) # 1 muestra con 2 características

# Pesos y bias de la capa oculta

W1 = np.array([[0.3, 0.7], [0.5, -0.2]]) # 2 neuronas, 2 entradas

b1 = np.array([0.1, -0.1])

# Propagación en la capa oculta

Z1 = np.dot(X, W1) + b1

A1 = sigmoid(Z1)

# Pesos y bias de la capa de salida

W2 = np.array([[0.6], [-0.4]]) # 1 neurona de salida

b2 = np.array([0.05])

# Propagación en la capa de salida

Z2 = np.dot(A1, W2) + b2

A2 = sigmoid(Z2) # Salida final

print(«Salida de la red neuronal:», A2)

Explicación

Se definen los datos de entrada.

Se multiplican por los pesos de la primera capa.

Se suman los sesgos.

Se aplica la función sigmoide en la capa oculta.

Se repite el proceso en la capa de salida.

Obtener la predicción final.

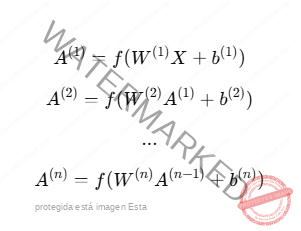

Propagación hacia adelante en redes profundas

En una red neuronal profunda con varias capas ocultas.

Propagación hacia adelante se repite.

En cada capa antes de llegar a la salida final.

Ejemplo con varias capas.

La propagación hacia adelante es para que una red neuronal.

Realice una predicción.

Cálculo de multiplicaciones de matrices y activaciones.

Pasa la información desde la entrada hasta la salida.

Se complementa con la propagación hacia atrás (backpropagation)

Ajustar los pesos y mejorar la precisión de la red.