LLM Feedback Loop Layer representa la evolución natural de los sistemas en la era de la inteligencia artificial: pasar de contenidos estáticos a sistemas que aprenden y se adaptan continuamente.

En este nuevo paradigma, ya no es suficiente con crear contenido optimizado; es necesario construir mecanismos que permitan a los modelos de lenguaje mejorar con cada interacción.

Esta capa de retroalimentación convierte cada uso, cada pregunta, cada respuesta, cada decisión, en una fuente de aprendizaje.

A través de ella, los sistemas pueden identificar qué funciona, qué no, y ajustar su comportamiento en tiempo real o de forma progresiva.

El resultado es una experiencia que se vuelve cada vez más precisa, relevante y personalizada.

Dominar el LLM Feedback Loop Layer implica entender cómo capturar señales, explícitas e implícitas, cómo estructurarlas para que sean interpretables por modelos, y cómo integrarlas en ciclos de mejora continua.

Desde métricas de calidad de respuesta hasta patrones de comportamiento del usuario, todo se convierte en input para refinar el sistema.

Pero no se trata solo de recopilar datos. La clave está en diseñar un flujo donde el feedback se transforme en decisiones:

Reentrenamiento, ajuste de prompts, modificación de estructuras de contenido o activación de agentes.

Es aquí donde los sistemas dejan de ser reactivos y empiezan a comportarse como entidades adaptativas.

En este contexto, el LLM Feedback Loop Layer actúa como el motor de evolución del ecosistema IA.

Es lo que permite que un sistema no solo responda, sino que mejore constantemente su capacidad de hacerlo bien.

Comprender este concepto es esencial para construir soluciones que no se queden obsoletas, sino que evolucionen con cada interacción.

Desarrolla en profundidad el concepto LLM Feedback Loop Layer → Mejorar la adaptación.

Con todos los aspectos que hay que tener en cuenta para dominarlo.

Este concepto es donde realmente se construyen ventajas competitivas sostenibles en sistemas basados en IA.

¿Qué es LLM Feedback Loop Layer?

El LLM Feedback Loop Layer es la capa que permite que un sistema basado en modelos de lenguaje:

Aprenda de cada interacción

Se adapte al contexto real de uso

Mejore continuamente sin rediseño manual constante

Es el paso de:

Sistemas estáticos prompt → Respuesta

Sistemas adaptativos input → Output → Feedback → Mejora

Principio base: sistemas que evolucionan

Un sistema sin feedback es un sistema que se degrada con el tiempo.

Un sistema con feedback bien diseñado:

Aprende patrones reales

Reduce errores recurrentes

Mejora la precisión contextual

Piensa en esto como un ciclo vivo:

Input → Output → Evaluación → Ajuste → Nuevo Output

Tipos de feedback

Feedback explícito, proviene directamente del usuario:

Ratings

Comentarios

Correcciones

Alta calidad, pero baja cantidad.

Feedback implícito, se deduce del comportamiento:

Tiempo de lectura

Reintentos de pregunta

Abandono

Clicks / Interacción

Menos preciso, pero escalable.

Feedback derivado sintético

Generado por sistemas:

Evaluadores automáticos LLM-as-judge

Comparación de outputs

Tests A / B

Clave para escalar sin depender solo de usuarios.

Captura de señales Signal Engineering

No todo feedback sirve. Hay que diseñar qué señales capturar.

Señales de calidad:

Exactitud

Relevancia

Completitud

Claridad

Señales de comportamiento:

Fricción

Iteración

Éxito en la tarea

Señales de negocio:

Conversión

Retención

ROI

Estás transformando interacción en datos accionables.

Interpretación del feedback

El mayor error: pensar que feedback = verdad.

Ejemplo:

Usuario abandona → ¿respuesta mala o ya encontró lo que quería?

Necesitas:

Contexto

Correlación de señales

Modelos de interpretación

Transformar feedback en mejora

El feedback debe traducirse en acciones como:

Prompt optimization

Ajustes dinámicos

Inyección de contexto

Refinamiento de instrucciones

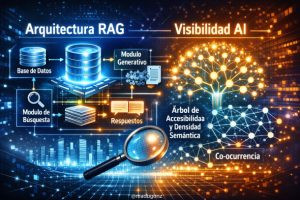

Retrieval optimization (RAG)

Mejorar fuentes

Reordenar resultados

Eliminar ruido

Model tuning

Fine-tuning

Re-ranking

Ajuste de embeddings

Content optimization

Reescribir contenido

Añadir definiciones

Mejorar estructura SEC

Feedback sin acción = ruido.

Ciclos de mejora loop design

Loop crto tiempo real

Ajuste en la misma sesión

Personalización instantánea

Loop medio

Ajustes diarios/semanales

Optimización continua

Loop largo

Reentrenamiento del sistema

Cambios estructurales

Memoria y contexto

Para adaptarse, el sistema necesita memoria:

Memoria de usuario

Memoria de sesión

Memoria global patrones

Sin memoria, no hay aprendizaje real.

Métricas

Quality score

Task success rate

Hallucination rate

Latencia

Engagement

El feedback se convierte en métricas → Decisiones.

LLM-as-a-Judge

Usar IA para evaluar IA.

Ejemplo:

Comparar respuestas

Puntuar calidad

Detectar errores

Escalas evaluación sin depender de humanos.

Arquitectura del sistema

Input layer usuario

LLM layer

Feedback capture layer

Evaluation layer

Optimization layer

Esto ya no es contenido, es infraestructura de inteligencia.

Riesgos y errores comunes

Feedback mal interpretado

Sobreoptimización overfitting a usuarios

Ignorar señales implícitas

No cerrar el loop, no aplicar mejoras

Falta de calidad en datos

El sistema puede empeorar si el feedback está mal diseñado.

Dejas de pensar en:

“crear contenido”

Y pasas a pensar en:

“diseñar sistemas que aprenden”

Tu activo ya no es el contenido, es el loop de mejora continua.

Un buen feedback loop crea:

Mejora exponencial

Personalización profunda

Barreras de entrada

Porque el sistema se vuelve mejor con el tiempo automáticamente.

Conclusión

LLM Feedback Loop Layer es el motor de adaptación en la era de la IA.

Permite que un sistema:

Aprenda de cada interacción.

Se ajuste continuamente.

Mejore su rendimiento con el tiempo.

Sin esta capa, tu sistema se queda estático.

Con ella, se convierte en un organismo inteligente en evolución.