Durante años, la Inteligencia Artificial se ha explicado como algo lejano, complejo y casi mágico.

Modelos, algoritmos, redes neuronales, siglas incomprensibles…

Como si para entenderla hiciera falta ser ingeniero, científico de datos o trabajar en Silicon Valley.

Pero la realidad es otra.

Un sistema de IA actual no es una caja negra inexplicable.

Es mucho más parecido a algo que todos conocemos: una empresa bien organizada, donde cada persona tiene un rol claro, se comunica con las demás y trabaja para lograr un objetivo común.

Imagina una empresa con un asistente inteligente.

Uno que no solo responde preguntas, sino que:

Consulta documentos internos

Toma decisiones

Usa herramientas

Ejecuta tareas reales

Y comprueba que todo se haya hecho bien.

Ese asistente no es una única pieza mágica. Es un equipo completo trabajando en segundo plano.

Hay un “cerebro” que piensa y redacta.

Hay una “biblioteca” que aporta información real.

Hay un “empleado” que organiza el trabajo y actúa.

Y hay un “sistema de conexiones” que permite hablar con el mundo exterior: correos, bases de datos, CRMs, calendarios…

Cuando entendemos la IA de esta forma —como un sistema de la vida diaria— deja de dar miedo y empieza a tener sentido.

En este artículo vamos a desmontar la arquitectura real de un sistema de IA actual, sin tecnicismos innecesarios, usando analogías claras y ejemplos cotidianos.

Qué hace cada pieza, por qué es necesaria y cómo se comunican entre sí para que una empresa pueda tener un asistente inteligente que realmente funcione.

No para ingenieros.

No para expertos en IA.

Sino para cualquiera que quiera entender cómo funciona de verdad la inteligencia artificial que ya está entrando en nuestras empresas.

Y una vez lo veas así, ya no volverás a pensar en la IA como algo mágico… sino como algo perfectamente lógico.

Conceptos clave en el desarrollo de una IA real

LLM (Large Language Model): Red neuronal que entiende y genera texto similar al humano, como GPT.

ChatGPT responde preguntas basadas en su entrenamiento.

Modelos como GPT-4 se entrenan en vastos datos de texto para predecir palabras.

Usan transformers; limitados por datos de entrenamiento, pueden «alucinar».

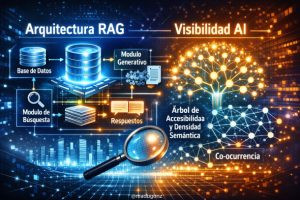

RAG (Retrieval-Augmented Generation): Técnica que recupera info externa antes de generar respuestas, mejorando precisión.

Un bot que consulta una base de datos de documentos antes de contestar, como en búsqueda legal.

Integra un retriever (ej. vector DB como Pinecone) con LLM para fetch info actualizada.

Conecta al asistente de IA con una “biblioteca inteligente” donde pueda buscar información actualizada antes de responder.

Muy simple;

Haz que la IA consulte información real y actualizada antes de dar una respuesta.

Es como permitir que la IA vaya a una biblioteca a buscar datos recientes antes de contestar, en lugar de responder solo de memoria.

Reduce errores, ideal para QA en dominios específicos.

AI Agent: Sistema autónomo que planifica y actúa con herramientas para lograr objetivos, como un asistente inteligente.

Grok usando herramientas para tareas complejas, como buscar info real-time.

Usa razonamiento (ej. ReAct) para descomponer tareas, invocar tools (APIs, búsquedas) e iterar.

Hace que la IA piense paso a paso, divida una tarea grande en partes pequeñas, use herramientas cuando las necesita y repita el proceso hasta completar el objetivo.

Es como pedirle a la IA que planifique lo que va a hacer, use las herramientas necesarias y vaya comprobando si todo está bien antes de terminar.

Permite que la IA razone como una persona: primero piensa qué hacer, luego actúa, comprueba el resultado y ajusta si hace falta.

Ej: Auto-GPT para objetivos complejos.

MCP (Model Context Protocol): Protocolo que conecta modelos de IA a datos externos y herramientas vía API unificada.

Un framework que integra LLMs con APIs externas para flujos de datos unificados, como en entornos empresariales.

Protocolo para estandarizar interacciones entre modelos IA y contextos externos (datos, tools) vía APIs, facilitando integración en sistemas escalables.

LLM (Large Language Model)

Un LLM es un modelo de IA basado en redes neuronales profundas, normalmente arquitecturas Transformer, entrenadas con enormes volúmenes de texto.

¿Qué hace realmente un LLM?

Aprende patrones estadísticos del lenguaje

Predice la siguiente palabra (token) dada una secuencia previa.

A partir de eso, puede:

Generar texto coherente

Resumir

Traducir

Programar

Razonar (de forma probabilística)

Cómo funciona (simplificado)

El texto se convierte en tokens

Cada token se transforma en un embedding (vector numérico)

El Transformer usa:

Self-Attention → entiende contexto

Capas profundas → aprende relaciones complejas

Genera la salida token a token

Fortalezas

Generalista

Lenguaje natural muy fluido

Capacidad de razonamiento emergente

Limitaciones

Puede alucinar

Conocimiento estático (fecha de entrenamiento)

No accede a datos privados sin ayuda externa.

Ejemplos: GPT-4/5, Claude, LLaMA, Mistral

RAG (Retrieval-Augmented Generation)

RAG combina un LLM con un sistema de recuperación de información para mejorar precisión y actualidad.

Problema que resuelve

Los LLM:

No conocen tus documentos

Pueden inventar respuestas

RAG inyecta conocimiento real antes de generar texto.

Flujo de RAG

El usuario hace una pregunta

Se convierte en un embedding

Se buscan documentos relevantes en:

Vector DB (FAISS, Pinecone, Weaviate)

Se recupera el contexto

El LLM genera la respuesta basándose en esos datos

Pregunta → Recuperación → Contexto → Generación

Ventajas clave;

Respuestas basadas en datos reales

Reduce alucinaciones

No requiere re-entrenar el modelo

Ideal para datos privados o cambiantes

Casos de uso;

Chatbots empresariales

Soporte técnico

Legal / médico

Análisis documental

Ejemplo: ChatGPT consultando tu base de datos interna

AI Agent (Agente de IA)

Un AI Agent es mucho más que un LLM respondiendo texto. Es un sistema autónomo orientado a objetivos.

Qué lo define;

Un agente:

Percibe el entorno

Planifica

Decide

Actúa

Evalúa resultados

Todo esto puede repetirse en bucle.

Arquitectura típica

LLM (razonamiento)

Objetivo definido

Herramientas (APIs, DBs, código, web)

Memoria (corto y largo plazo)

Loop de ejecución

Ejemplo real;

“Consigue 20 leads B2B esta semana”

El agente:

Analiza el objetivo

Diseña un plan

Usa herramientas (CRM, scraping, email)

Evalúa resultados

Ajusta la estrategia

Diferencia clave

Chatbot AI Agent

Reactivo Proactivo

Responde Ejecuta acciones

Sin estado Mantiene memoria

Frameworks: LangGraph, AutoGPT, CrewAI, OpenAI Agents

MCP (Model Context Protocol)

MCP es un protocolo estándar que permite conectar modelos de IA con datos, herramientas y sistemas externos de forma estructurada.

Qué problema soluciona;

Sin MCP:

Integraciones ad-hoc

APIs distintas para cada herramienta

Contexto desordenado

Con MCP:

Interfaz unificada

Contexto controlado

Acceso seguro a recursos

Qué permite MCP;

Conectar LLMs a:

Bases de datos

CRMs

ERPs

Sistemas internos

Exponer capacidades como:

Consultas

Acciones

Lectura/escritura

Concepto clave;

MCP separa:

Modelo (razona)

Contexto (datos, herramientas)

Servidor MCP (orquestación)

LLM ↔ MCP Server ↔ Tools / Data

Beneficios;

Escalabilidad

Seguridad

Interoperabilidad

Ideal para agentes complejos

MCP es especialmente potente cuando lo combinas con AI Agents + RAG.

Visión global: cómo encajan

LLM → Razona y genera

RAG → Aporta conocimiento real

AI Agent → Planifica y actúa

MCP → Conecta todo de forma estándar

Stack actual de IA:

LLM como cerebro

RAG como memoria externa

Agents como ejecutores

MCP como sistema nervioso

Arquitectura sencilla de un sistema de IA actual.

Imagina una empresa con un asistente inteligente que responde preguntas y hace tareas.

1. El cerebro: LLM

Qué es;

El LLM es el cerebro del sistema.

Qué hace;

Entiende lo que le dices

Piensa qué responder

Decide qué hacer

Qué NO hace bien solo;

No conoce tus datos internos

No ejecuta acciones reales

Ejemplo:

“Explícame este contrato”

“Responde a un cliente”

2. La biblioteca: RAG

Qué es;

RAG es como una biblioteca inteligente conectada al cerebro.

Qué hace;

Busca información real en documentos

Selecciona solo lo importante

Se lo pasa al LLM antes de responder

Por qué es clave;

Evita que la IA se invente cosas.

Ejemplo:

PDFs

Manuales

Políticas internas

Base de conocimiento

El LLM no responde “de memoria”, responde con pruebas.

3. El empleado autónomo: AI Agent

Qué es;

El AI Agent es el que trabaja.

Qué hace;

Tiene un objetivo

Decide los pasos

Usa herramientas

Comprueba si lo hizo bien

Diferencia importante;

El LLM piensa

El agente actúa

Ejemplo de objetivo:

“Resuelve el ticket del cliente”

El agente:

Lee el problema

Busca info (RAG)

Decide qué hacer

Ejecuta acciones

Verifica resultado

4. El enchufe universal: MCP

Qué es;

MCP es el enchufe estándar que conecta la IA con el mundo real.

Qué conecta;

Bases de datos

CRM

ERP

Calendario

APIs internas

Por qué importa;

Sin MCP → cada conexión es un lío

Con MCP → todo se conecta igual

Ejemplo:

“Crea una oportunidad en el CRM”

El agente no sabe cómo hacerlo.

MCP se encarga.

Cómo funciona todo junto (paso a paso)

Usuario;

“¿Qué dice nuestra política de devoluciones y crea una respuesta para el cliente Juan?”

Flujo sencillo;

Usuario habla

El mensaje entra al sistema

AI Agent toma el control

Entiende que hay:

Una pregunta

Una acción

RAG busca información;

Consulta la política de devoluciones real

LLM genera la respuesta

Usa solo la info encontrada

MCP ejecuta la acción

Guarda la respuesta o la envía por email

Agente valida

Comprueba que todo salió bien

Quién hace qué (en una frase)

LLM → piensa y escribe

RAG → aporta información real

AI Agent → organiza y actúa

MCP → conecta con sistemas reales