La arquitectura Transformer es el pilar fundamental sobre el que se construyen los Large Language Models LLMs como GPT, BERT, LLaMA o Gemini.

Propuesta por primera vez en el paper «Attention Is All You Need» 2017, revolucionó el procesamiento del lenguaje natural al abandonar por completo las redes recurrentes RNN y convolucionales CNN, reemplazándolas por un mecanismo llamado autoatención self-attention.

El problema que resuelve el Transformer

Antes del Transformer, los modelos procesaban el texto de forma secuencial palabra por palabra, lo que dificultaba:

El paralelismo no se podían entrenar todas las palabras a la vez.

La captura de dependencias de largo alcance la información de palabras muy separadas se diluía.

El Transformer permite que cada palabra «vea» a todas las demás al mismo tiempo, gracias a la autoatención.

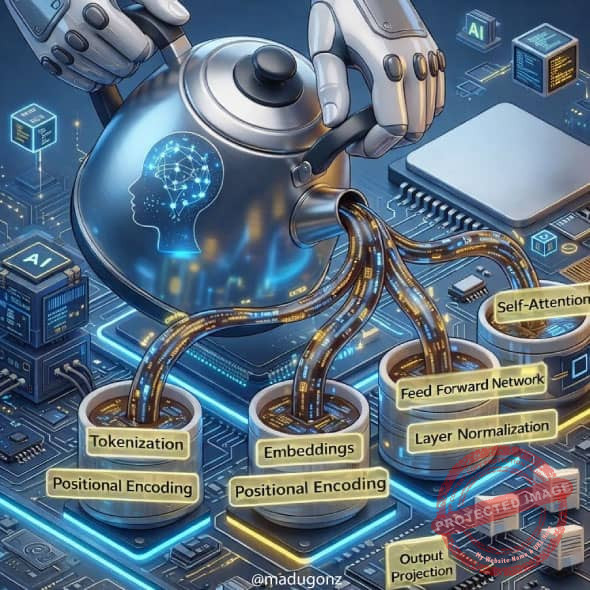

Componentes clave de la arquitectura Transformer en LLMs

Tokenización y embeddings

El texto de entrada se divide en tokens palabras o subpalabras.

Cada token se convierte en un número Token ID y luego en un vector denso mediante una capa de embeddings.

Este vector captura el significado semántico de la palabra.

Positional Encoding – Codificación posicional

Como el Transformer no procesa secuencialmente, necesita añadir información sobre la posición de cada token en la frase.

Se inyecta un vector de posición a cada embedding, típicamente mediante funciones seno y coseno o parámetros aprendibles.

Self-Attention – Mecanismo de autoatención

Es el corazón del Transformer. Para cada token se calculan tres vectores:

Query Q : Lo que el token busca.

Key K : Lo que cada token ofrece.

Value V : La información real que se transmite.

Se calcula la similitud entre Q y K de todos los pares de tokens atención, se normaliza con softmax y se usa como peso para sumar los Values.

El resultado es que cada token recibe información de toda la secuencia, ponderada por relevancia.

Multi-Head Attention – Atención multi-cabeza

En lugar de una sola atención, se ejecutan varias en paralelo cabezas, cada una aprendiendo diferentes tipos de relaciones sintácticas, semánticas, de referencia, etc.

Luego se concatenan los resultados.

Bloque Transformer se repite N veces

Cada bloque contiene:

Multi-Head Self-Attention

Add & Norm conexión residual + normalización por capas

Feed Forward Network FFN: Dos capas lineales con no linealidad intermedia

Add & Norm otra vez

Las conexiones residuales evitan la degradación del gradiente y aceleran el entrenamiento.

La FFN añade capacidad de cómputo no lineal.

Salida y generación

El último bloque produce vectores que pasan por una capa de proyección lineal + softmax para obtener probabilidades sobre el vocabulario.

En los LLMs generativos como GPT, se predice el siguiente token, se añade a la entrada y se repite el proceso de forma autorregresiva.

Entrenamiento de un LLM basado en Transformer

Objetivo: Predecir el siguiente token entrenamiento autorregresivo o enmascarar tokens aleatorios como en BERT.

Datos: Ingentes cantidades de texto libros, páginas web, artículos científicos, código, etc.

Optimización: Retropropagación backpropagation y descenso del gradiente.

Aprendizaje implícito: El modelo aprende gramática, hechos del mundo, razonamiento analógico y patrones lingüísticos sin anotaciones manuales.

Por qué el Transformer potencia los LLMs actuales

| Ventaja | Explicación |

| Alto paralelismo | Todos los tokens se procesan simultáneamente en la atención, a diferencia de las RNN secuenciales. |

| Escalabilidad | Al añadir más datos, más parámetros o más cómputo, el rendimiento mejora de forma predecible leyes de escala. |

| Contexto largo | Puede capturar dependencias entre tokens muy distantes sin problema de desvanecimiento de gradiente. |

| Flexibilidad | Sirve tanto para modelos solo decodificador GPT, solo codificador BERT o codificador-decodificador T5. |

Limitaciones y evolución

A pesar de su éxito, el Transformer tiene un costo cuadrático respecto a la longitud del contexto O n², lo que dificulta manejar millones de tokens.

Por eso han surgido variantes como Longformer, BigBird o Mamba basado en SSM.

El Transformer sigue siendo la arquitectura dominante en LLMs comerciales y de investigación.

La arquitectura Transformer permite a los LLMs procesar texto en paralelo, capturar relaciones complejas entre todas las palabras mediante autoatención y escalar eficientemente con más datos y cómputo.

Es la base de modelos como GPT-4, Claude, LLaMA y Gemini, y su diseño modular bloques repetidos, atención multi-cabeza, conexiones residuales explica por qué hoy podemos conversar con inteligencias artificiales que parecen comprender el lenguaje humano.

Input Processing – Procesamiento de la entrada

Tokenization

Divide el texto bruto en unidades más pequeñas llamadas tokens palabras, subpalabras o caracteres.

Función: Reducir la complejidad del texto y crear un vocabulario manejable para el modelo.

Token IDs

Asigna un número entero único a cada token del vocabulario.

Función: Convertir los tokens en una representación numérica que la máquina pueda procesar.

Embedding Layer

Convierte cada Token ID en un vector denso de números decimales embedding.

Función: Capturar relaciones semánticas y sintácticas entre tokens similares tienen vectores cercanos.

Positional Encoding

Añade información sobre la posición del token dentro de la secuencia por ejemplo, usando senos y cosenos o parámetros aprendibles.

Función: Como el Transformer no es recurrente, necesita saber el orden de las palabras.

Attention Mechanism – Mecanismo de atención

Self-Attention

Permite que cada token examine todos los demás tokens de la secuencia para decidir a cuáles prestar más atención.

Query Q

Vector que representa “lo que el token actual está buscando” en otros tokens.

Key K

Vector que representa “lo que cada otro token ofrece” como posible información relevante.

Value V

Vector que contiene el contenido real del token, que se propagará si la atención es alta.

Attention Scores

Se calculan como el producto punto entre Query y Key normalizado.

Indican la relevancia entre un token y cada otro token.

Weighted Sum

Se multiplica cada Value por su atención score y se suman.

Función: Agregar la información relevante de toda la secuencia en la representación de cada token.

Transformer Block – Bloque Transformer, repetido N veces

Multi-Head Self-Attention

Ejecuta varios mecanismos de atención en paralelo varias cabezas y concatena los resultados.

Función: Capturar diferentes tipos de relaciones sintácticas, semánticas, de largo alcance simultáneamente.

Add & Norm

Add conexión residual: Suma la entrada original del bloque con la salida de la atención.

Norm Layer Normalization: normaliza los valores para estabilizar el entrenamiento.

Función: Evitar la degradación del gradiente y acelerar la convergencia.

Feed Forward Network FFN

Red de dos capas lineales con una no linealidad ReLU, GELU en medio.

Se aplica a cada token por separado.

Función: Transformar la representación obtenida por la atención y añadir capacidad de cómputo no lineal.

Segundo Add & Norm

Similar al anterior, pero después de la FFN.

Función: Mantener la estabilidad y permitir que la red aprenda identidad si es necesario.

Training Process – Proceso de entrenamiento

Trained on massive text datasets

Se usa una gran cantidad de texto libros, web, artículos sin anotaciones manuales.

Objective: Next Token Prediction

El modelo aprende a predecir el siguiente token dada una secuencia anterior entrenamiento autorregresivo.

Learns grammar, facts, reasoning patterns

De forma implícita, el modelo captura reglas gramaticales, conocimiento factual y patrones de razonamiento.

Optimized using backpropagation and gradient descent

Se ajustan los pesos mediante retropropagación del error y descenso del gradiente.

Por qué los Transformer alimentan los LLMs

Highly parallelizable

A diferencia de las RNNs, todos los tokens se procesan en paralelo en atención.

Scales efficiently

Al aumentar datos y cómputo, el rendimiento mejora de forma predecible leyes de escala.

Captures long-context dependencies

La atención directa entre tokens lejanos evita la desaparición del gradiente recurrente.

Backbone of models like GPT, BERT, T5

Arquitectura base de los principales LLMs actuales.

Simple Flow Summary – Resumen del flujo

Input Text

Tokenización → Dividir en tokens

Embeddings → Vectores densos

Embeddings + Positional Encoding → Añadir orden

Transformer Layers Attention + FFN, repetido N veces

Output Probabilities softmax sobre el vocabulario

Generated Text muestreo de la distribución

Key Components Overview – Componentes clave

| Componente | Función principal |

| Tokenization | Dividir texto en unidades manejables |

| Embeddings | Convertir tokens a vectores semánticos |

| Positional Encoding | Añadir información de orden |

| Self-Attention | Modelar dependencias entre todos los tokens |

| Feed Forward Network | Transformar representaciones y añadir no linealidad |

| Residual Connections | Facilitar el flujo de gradientes y aprender identidad |

| Layer Normalization | Normalizar activaciones para entrenamiento estable |

| Output Projection | Proyectar la salida final al tamaño del vocabulario |