Posicionamiento SEO: Aprender SEO puede ser una tarea tan fácil como difícil, dependiendo si das con la información necesaria, hay tanta información sobre Seo y tantos cambios que se producen en SEO, que se puede convertir en una tarea realmente difícil.

Ya que si no sabes seleccionar cual es la información que te va a aportar los conocimientos necesarios, puede resultar muy complicado.

¿Qué es Seo?

SEO (Search Engine Optimization)

El posicionamiento en buscadores, optimización en motores de búsqueda, es un conjunto de acciones orientadas a mejorar el posicionamiento de un sitio web en la lista de resultados de Google, Bing, u otros buscadores de internet, para mejorar la visibilidad de un sitio web.

A través de aspectos técnicos como la optimización de la estructura y los metadatos de una web, contenidos, con el objetivo de ser útiles y relevantes para los usuarios.

Pautas a seguir

1. Directrices de Google

Directrices para webmasters

- Guía de optimización en buscadores (SEO) para principiantes

- Proteger sitios web con el protocolo HTTPS

- Cómo simplificar la estructura de direcciones URL

- Informar a Google del tipo de enlaces salientes de un sitio web

- Etiquetar sitio para marcar como contenido dirigido a niños

- Compatibilidad de navegadores

- Contenido duplicado

- Permitir el rastreo de enlaces

- Prácticas recomendadas para probar un sitio web teniendo en cuenta la Búsqueda de Google

Directrices de contenido

- Directrices de AMP en la Búsqueda de Google

- Sitios con AJAX mejorado

- Imágenes y vídeos

- Podcasts

- Móviles

Directrices de calidad

- Contenido generado automáticamente

- Redireccionamientos engañosos

- Esquemas de enlaces

- Encubrimiento

- Texto y enlaces ocultos

- Páginas puerta

- Contenido copiado

- Programas de afiliados

- Uso excesivo de palabras clave

- Creación de páginas con comportamiento malicioso

- Directrices para spam generado por usuarios

- Formas de evitar los comentarios con spam

- Informar sobre spam, enlaces de pago o software malicioso

Foro de ayuda para Webmasters

General Guidelines Overview (inglés)

Guía de optimización en buscadores (SEO) para principiantes

Historia de Google: del PageRank a su modelo de negocio

Hay una parte del Seo que es muy técnica, que también interesa conocer, sino en profundidad, sí que forman parte del ámbito del Seo.

Seo técnico avanzado;

- cómo funciona el buscador

- conceptos sobre protocolos web

- distinguir lenguajes de programación (lado cliente y servidor)

- sistemas operativos

- tecnologías web

- relacionar fundamentos de programación con la realidad de los proyectos.

Conocer estos aspectos no son completamente necesarios para empezar a trabajar con el Seo, pero sí para ampliar conocimientos sobre como se estructura.

2. Proyecto web

Necesitas un proyecto web y empezar a trabajar en él. Para ello necesitas conocer qué es un CMS (sistema de gestión de contenidos) y los distintos sistemas de gestión que hay.

Cómo crear una página web en WordPress

- WordPress

Cómo crear una página web en Drupal y Joomla

- Drupal

- Joomla

Cómo crear una página web en Editor visual

- Webnode

3. Formación

- Curso SEO fácil y efectivo de Borja Girón

- Curso Dispara tus visitas de Dean Romero

- Curso SEO online de Aula CM

- Curso SEO de Romuald Fons

- Curso Seo Team Platino de Chuiso

- Curso Seo Webpositer Academy

- Curso SEO avanzado de Miguel Florido

- Curso Seo Quondos de Alex Navarro

- Curso Seo TecnicaSEO de Natan Valencia

- Curso SEO de HolaSEO

- Curso SEO en Udemy de Juan José Ramos

- Curso de SEO de David Ayala

Blogs de Seo (español)

- Campamento Web

- Chuiso

- David Ayala

- Dean Romero

- Human Level

- Iñaki Huerta

- Javier Gosende

- Javier Ramos Carro

- José B. Moreno

- Juan González Villa (USEO)

- Julio Romero

- Lino Uruñuela

- Luis M. Villanueva

- MJ Cachón

- Nacho Monterde (SEO Azul)

- Natzir Turrado

- Rubén Alonso

- SEMrush

- Sistrix

- Webmasters de Google

- Vivir de la red

Mujeres Seo

Blogs de Seo (inglés)

- Ahrefs

- Backlinko

- Backlinko

- Blurbpoint

- Botify

- CognitiveSEO

- Conversión XL

- Crazy Egg

- DeepCrawl

- Dejan Seo

- Distilled

- Hobo Blog

- HubSpot

- IloveSeo

- Kaiserthesage

- Kissmetrics

- Link Assintant

- Matt Cutts

- Mattherwwoodward

- Moz

- Optimize Smart

- Point Blanck

- Quick Sprout

- Radical Mustache

- Reef

- Reliablesoft

- Search Engine Journal

- Search Engine Land

- Search Engine People

- Search Engine Roundtable

- Search Engine Watch

- Search Metrics

- Seo Book

- SEO by the Sea

- Seo Gadget

- SERPStat

- TheSEMPost

- Yoast

- ZYPPY

Videos

- Ahref (inglés)

- Borja Girón

- Brian Dean (inglés)

- Chuiso

- Iván García

- Luis M. Villanueva

- Ministerio Seo

- Nathan Gotch (inglés)

- Romuald Fons

- SEMrush (inglés)

- SEMrush (español)

- Google Webmasters (en inglés)

Podcast

- Blog del Seo

- Borja Girón

- Campamento web

- Hola Seo

- La Máquina del Seo

- Reportin

- Seo Profesional

Eventos

- Clinic Seo

- Congreso Seo para Seos

- Congreso Seo Profesional

- Congreso Web

- Ensalada Seo

- Evento Seo

- Seonthebeach

- SeoPlus

Libros

200 + 1 Factores de posicionamiento en Google 2018: Guía práctica para aprender SEO paso a paso. Marta Fedriani (español)

Libro SEO: Técnicas avanzadas. Las claves para ser los primeros. Fernando Maciá (español)

SEO: Las claves esenciales. Aleyda Solís (español)

SEO para ecommerce. Jordi Ordóñez y Miguel Nicolás (español)

Cien elementos que debe tener un sitio web. Juan Carlos Camus (español)

Las claves para dominar el SEO: Todo lo que has de saber para posicionar una web en Google. José Noguera (español)

Posicionamiento web para todos: El manual sobre SEO para aprender cómo aparecer en las primeras posiciones de los buscadores. Rodrigo Tovar Monge (español)

Posicionarse en Google (sin tonterías): Guía SEO básica y completa. Pau Ninja (español)

SEO avanzado para bloggers: Pasa al siguiente nivel y consigue aún más visitas de calidad. Borja Girón

SEO fácil y útil: Cómo conseguir visitas a tu web con posicionamiento en buscadores. Curso manual. Diego C. Martín

SEO para WordPress: Optimiza WordPress para que Google ame tu blog. José Noguera (español)

SEO Técnicas avanzadas. Fernando Macía Domene (español)

The Art of SEO: Mastering Search Engine Optimization. Jessie C. Stricchiola, Eric Enge y Stephan Spencer (inglés)

3 Months to Nº1: The «No-Nonsense» SEO playbook for getting your website found on Google. Will Coombe (inglés)

The SEO Battlefield: Winning Strategies for Search Marketing Programs de Anne Ahola Ward. Anne Ahola Ward (ingés)

4. Profesionalización

Si quieres avanzar y profesionalizarte necesitas realizar una formación muy específica, con profesionales y especialistas en la materia.

✔️ Recomendado: Master SEO de Webpositer

5. Experimentación

Es importante que empieces a familiarizarte con el mundo del Seo desde el principio, la teoría es necesaria, pero una vez tengas los conocimientos necesarios para saber identificar los términos prinicipales y más importantes, empieces a ponerlos en práctica.

Para ello te propongo un reto, que empieces a pensar y actuar como un Seo desde el principio, a pensar en Seo.

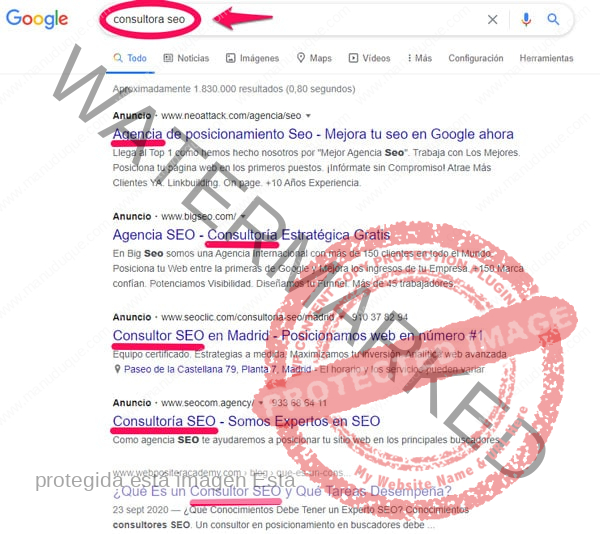

¿Qué haces cuando quieres obtener información sobre algo? Acudir a google, en este caso queremos aprender Seo, pues vamos a ello;

«Quiero aprender SEO: ¿Cómo lo hago? ¿Por dónde empiezo?»

A partir de esta búsqueda, investiga los resultados, busca información al respecto, ten en cuenta que estos resultados son los que más se pueden acercar a tu búsqueda, google así lo quiere, pregunta (query) realizada, resultado ofrecido, de entre todas sus bases de datos google se encarga de ofrecer el mejor resultado posible para esa búsqueda.

El Seo trata de investigar, probar, experimentar, de prueba y error, comprobar si los cambios que hemos realizado funcionan, comprobar que cosas funcionan y nos acercan a nuestros objetivos y cuales no.

No hay fórmulas específicas para cada caso, hay reglas generales y acciones específicas que se aplican a cada caso, se comprueban los resultados y se implementan en caso que no resulten positivos.

No hay una regla universal que valga igual para todos los proyectos, hay reglas básicas generales que se pueden aplicar a todos los proyectos y reglas específicas para cada uno, me explico;

Reglas generales comunes para todos los proyectos;

- Directrices para webmasters

- Directrices generales

- Directrices de contenido

- Directrices de calidad

Reglas específicas para cada proyecto;

Acciones concretas de actuación sobre determinadas cuestiones.

(Por ejemplo; Seo On page, Seo Off page, WPO, Arquitectura web, Linkbuilding, Keyword Research, Enlazado interno, etc.)

Si quieres aprender Seo, tienes que conocer su historia, su evolución y hacia dónde va, para poder trabajar en el sector y entender cómo afectan sus cambios.

Este vídeo sirve como ejemplo de cómo ha evolucionado el Seo, desde sus orígenes hasta la actualidad;

- Historia

- Antes vs. Ahora

- Evolución

- Cambios actuales

fuente: Canal Luis Villanueva – Experimentos

Con toda esta información puedes empezar a trabajar en Seo, incluso sin realizar ninguna formación específica, la base es el conocimiento, la teoría, todo lo demás es poner en práctica la teoría.

Ten en cuenta que google realiza cambios constantemente y lo que vale hoy, puede no valer mañana. Y esto si es una regla general para todos.

Tienes que aprender a implementar constantemente tus acciones, ni el más experimentado Seo tiene la certeza 100% de que las acciones que realice pueden funcionar completamente.

Cuanto más experimentes y trabajes en Seo, más certezas encontrarás, pero no tienen por qué perdurar en el tiempo.

Con lo cual es necesario, controlar, implementar y hacer los cambios necesarios cada día, en cada caso y en cada situación.

En el posicionamiento Seo intervienen muchos factores, es un conjunto de variantes que interactúan entre sí, como el keyword research, linkbuilding, factores de Seo técnico, Contenidos y muchos más.

6. Técnicas Seo

Keyword Research

Keyword research es el término que se emplea para definir la búsqueda y análisis de palabras clave, mediante este estudio se determinan cuales son esas palabras que van a formar parte de nuestro contenido.

Qué palabras clave son las adecuadas para que el usuario en su búsqueda encuentre nuestros contenidos.

Hay diferentes herramientas y estrategias para elegir y seleccionar cual son las que mejor pueden posicionar nuestra página o sitio web y cómo hacer un Keyword Research.

El keyword research o estudio de palabras clave, es el procedimiento a través del cual se identifican las palabras clave que nos permiten que los buscadores encuentren un contenido.

El estudio o análisis de palabras clave es la parte más importante del keyword research, la búsqueda de palabras clave o frases clave.

Para ser visibles en los buscadores en las posiciones orgánicas o de pago por clic para atraer tráfico.

Si atendemos a la propia descripción que hace el propio google de lo que es el Posicionamiento Seo y cómo funciona la Búsqueda de Google, estaremos ante los mejores resultados posibles.

El keyword research o la investigación de palabras clave consiste en comprender el mercado objetivo al que va dirigido y cómo el público objetivo, buscan ese contenido, servicios o productos.

La investigación de palabras clave proporciona datos de búsqueda específicos que pueden ayudar a responder preguntas como:

- ¿Qué busca la gente?

- ¿Cuántas personas lo están buscando?

- ¿En qué formato quieren esa información?

Antes de realizar la investigación de palabras clave, hay que hacerse las preguntas adecuadas, quiénes son tus clientes y cuales son tus objetivos.

Centrando la búsqueda en tu audiencia y usar datos de palabras clave para perfeccionar esos conocimientos.

Para hacerlo, haz preguntas como:

- ¿Qué tipos de productos busca la gente?

- ¿Quién busca estos términos?

- ¿Cuándo los buscan?

- ¿Hay tendencias de estacionalidad a lo largo del año?

- ¿Cómo lo buscan?

- ¿Qué palabras usan?

- ¿Qué preguntas hacen?

- ¿Se realizan más búsquedas en dispositivos móviles?

- ¿Por qué lo buscan?

- ¿Las personas buscan productos específicos o simplemente buscan información?

- ¿Dónde se encuentran los clientes potenciales: a nivel local, nacional o internacional?

- ¿Cómo puedes ayudar a proporcionar el mejor contenido sobre tus productos?

Para cultivar una comunidad y cumplir con lo que todas esas personas están buscando?

Hacer estas preguntas es un paso de planificación importante, que guiará la investigación de palabras clave y ayudará a crear un mejor contenido.

- ¿Qué términos busca la gente?

- ¿Cómo busca tu audiencia el producto, servicio o información que proporciona?

Responder a esta pregunta es un primer paso en el proceso de investigación de palabras clave.

Es posible que tengas en mente algunas palabras clave para las que te gustaría clasificar, como productos, servicios y otros temas relacionados con el sitio web, éstas son unas buenas palabras clave iniciales para la investigación.

Puedes ingresar esas palabras clave en una herramienta de investigación de palabras clave para descubrir el volumen de búsqueda mensual promedio y palabras clave similares.

Esto puede ayudar a determinar qué variaciones de palabras clave son más populares entre los buscadores, descubriendo otras palabras clave, preguntas comunes y temas para tu contenido que de otro modo podrían haberse perdido.

En el proceso de descubrir palabras clave relevantes para tu contenido, el volumen de búsqueda de esas palabras clave varía, los términos con un volumen de búsqueda más bajo son mucho menos competitivos.

La mayoría sitios web reciben más tráfico orgánico a otras páginas además de la página de inicio, por lo que es tan importante diversificar las páginas de tu sitio web optimizando cada una de ellas para palabras clave de valor único.

¿Con qué frecuencia se buscan esos términos?

Cuanto mayor sea el volumen de búsqueda para una palabra clave o frase de palabras clave determinada, normalmente se requiere más trabajo para lograr clasificaciones más altas.

La dificultad de palabras clave y los elementos que incorpora, características en las SERP, como fragmentos destacados, gráficos de conocimiento, carruseles de imágenes, vídeos, etc.

Cuanto mayor es el volumen de búsqueda, mayor es la competencia y la dificultad para lograr el éxito en el ranking orgánico.

Puede resultar más beneficioso apuntar a términos de búsqueda muy específicos y de menor competencia, las llamadas palabras clave de cola larga, palabras clave long tail.

La búsqueda de palabras clave o keywords es la base del SEO de cualquier sitio web, sabiendo por qué palabras clave llegan los usuarios a nuestra web, podremos aumentar y optimizar el tráfico de las keywords.

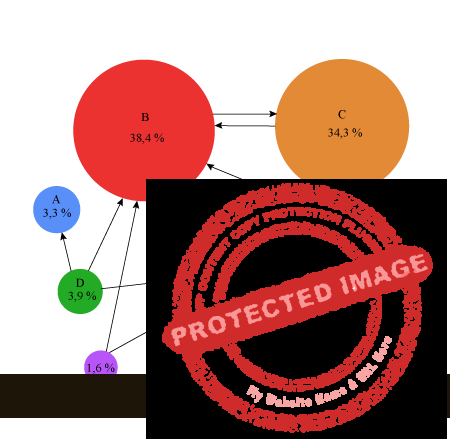

Descripción de la curva de demanda de búsqueda;

- Palabras clave principales con alto tráfico y competencia.

- Palabras clave medianas con tráfico y competencia medios.

- Palabras clave menos populares y frases más largas de palabras clave con menos tráfico y menor competencia.

Las palabras clave long tail, con un volumen de búsqueda más, tienen un mejor porcentaje de conversión, porque son más específicas e intencionales en sus búsquedas.

Por ejemplo, para la búsqueda «consultora Seo», el buscador entiende que la intención de búsqueda del usuario es una Consultoría Seo, y no una consultora, en femenino, de profesional Seo, de ahí la importancia de las Palabras clave long tail, proporcionan más información para identificar la intención de búsqueda real del usuario.

Tienen menos búsquedas, son más específicas, pero con un mayor ratio de clics.

Descubrir qué preguntas hacen las personas en su sector, y agregar esas preguntas y sus respuestas a una página de preguntas frecuentes, puede generar un tráfico orgánico valioso para el sitio web.

Términos de búsqueda relevantes para el sitio y sus volúmenes de búsqueda correspondientes, observando a los competidores, la temporalidad y la ubicación.

Palabras clave por competidor;

- Priorizar las palabras clave de alto volumen para las que sus competidores no están clasificando actualmente.

- Qué palabras clave ya están clasificando tus competidores y priorizarlas, aprovechando las oportunidades perdidas de sus competidores.

Palabras clave por temporada;

- Conocer las tendencias estacionales puede resultar valioso para establecer una estrategia de contenido.

Palabras clave por región;

- Apuntar de manera más estratégica a una ubicación específica al limitar su investigación de palabras clave a ciudades, condados o estados específicos en el Planificador de palabras clave de Google, o evaluar el «interés por subregión» en Tendencias de Google.

La investigación geo-específica puede ayudar a que el contenido sea más relevante para tu público objetivo.

¿Qué formato se adapta mejor a la intención del buscador?

Comprender cómo los buscadores quieren consumir información para una palabra clave en particular.

El formato en el que Google elige mostrar los resultados de la búsqueda depende de la intención, y cada consulta tiene una única.

Google describe estas intenciones en sus Directrices para evaluadores de calidad como «saber» (encontrar información), «hacer» (lograr un objetivo), «sitio web» (encontrar un sitio web específico) o «visitar en persona» (visitar un sitio, negocio).

Cinco categorías principales de intención:

- Consultas informativas: el buscador necesita información.

- Consultas de navegación: el buscador desea ir a un lugar en particular en Internet, como Facebook o una página de inicio.

- Consultas transaccionales: el buscador quiere hacer algo, como comprar un billete de avión o escuchar una canción.

- Investigación comercial: El buscador quiere comparar productos y encontrar el que mejor se adapte a sus necesidades específicas.

- Consultas locales: el buscador desea encontrar algo localmente, como una cafetería, un comercio o un lugar cercano.

Un paso importante en el proceso de investigación de palabras clave es investigar en las SERP para la palabra clave, para obtener un indicador de la intención del buscador.

Google ha evaluado el comportamiento de billones de búsquedas, para proporcionar el contenido más deseado para cada búsqueda de palabras clave específicas.

Tipos de keywords:

1. Palabras clave según la intención del usuario

Objetivo del usuario cuando realiza la búsqueda

- Informativas: Busca información.

- Transaccionales: Busca realizar una transacción (comprar algo, descargar documento, etc.)

- Navegacionales: Búsqueda encontrar contenido, información, etc.

Se pretende solucionar y satisfacer la búsqueda del usuario para aparecer en los resultados de búsqueda, a través del buscador, que intenta resolver la intención de búsqueda, mediante palabras o frases clave como;

“keyword research”

“keyword research para contenidos”

“que es un keyword research”

“como hacer el keyword research”

“como se hace el keyword research”

“como hacer keyword research”

“keyword research tools”

2. Palabras clave según el volumen de búsquedas

- Short tail; búsquedas de una sola palabra, muy amplias, gran volumen de búsquedas y competencia.

- Middle Tail: Búsquedas más específicas, pero siguen siendo genéricas.

- Long Tail: Búsquedas muy concretas, poca competencia y transaccionales.

3. Palabras clave por contenido

- Genéricas

- Geográficas o locales

- De marca

4. Palabras clave por intención

- Know: Búsquedas de usuarios que están explorando o investigando.

- Do: Búsquedas pueden suceder antes o después de la compra, son momentos de «cómo hacerlo».

- Website: Búsqueda en las que el usuario desea acceder a un sitio web de destino que conoce.

- Visit in person: Búsquedas de un negocio local o están considerando ir a una tienda local, a comprar un producto.

5. Palabras clave por customer journey

- Awareness: Búsquedas que están al inicio del problema del usuario.

- Consideration: Búsquedas de consultas del usuario que intentan saber cómo resolver su problema, reunir más información sobre las posibles soluciones.

- Decision: Búsquedas que conducen a la transacción y pueden diferenciarse por ser más orientadas a acciones como solicitar una demostración, etc.

- Purchase: Búsquedas influenciadas por la fase anterior, que pone fin o soluciona el problema inicial del usuario.

La investigación de palabras clave, las estrategias de contenido, junto con las estategias de linkbuilding, es el proceso a través del cual, se genera tráfico de manera constante a lo largo del tiempo.

La investigación de palabras clave ayuda a comprender exactamente qué contenido crear para mejorar tus objetivos comerciales y orientar el tráfico relevante.

Para encontrar frases y temas que:

- Son más relevantes para un negocio

- Tienen un volumen de búsqueda suficientemente alto.

- Tienen poca competencia

La investigación de palabras clave ayuda a encontrar palabras clave adicionales y relacionadas que busca tu audiencia, que puede usar para expandir su hoja de ruta de contenido y ofertas de productos.

Matriz de investigación de palabras clave;

Descubrir temas y frases de palabras clave valiosos; conocer las formas en que las personas realizan búsquedas que pueden llevar a tu sitio web.

Una estrategia inteligente de investigación de palabras clave, ayuda a descubrir oportunidades de palabras clave.

- Palabras clave con suficiente volumen de búsqueda, la investigación de palabras clave y la regla 80/20, solo el 20% de las palabras clave que las personas buscan serán términos populares «principales».

- Palabras clave por las que realmente se pueda clasificar.

- Palabras clave que sean valiosas para tu negocio, pero no tan competitivas como para que no se tenga la oportunidad de clasificarlas.

- Palabras clave con alta demanda y poca competencia.

- Hay otras consideraciones que hay que incluir al crear una lista de palabras clave, incluido el idioma, la estacionalidad y las tasas de clics.

- Elaboración de una estrategia de contenido completa a partir de la investigación de palabras clave.

- Crear un plan para crear contenido en torno a esas palabras clave, estrategia de contenido o hoja de ruta de contenido.

Para realizar una investigación de palabras clave hay que responder preguntas como:

- ¿Cuáles son mis temas principales y cuáles son mis temas secundarios?

- ¿Cuándo puedo segmentar varias palabras clave en una sola página y cuándo debo dividirlas en páginas independientes?

- ¿Qué tipo de contenido esperan los usuarios al buscar cada frase?

- ¿Dónde se ubica cada frase en el recorrido de mi visitante; conciencia> interés> compra?

Desarrollar una estrategia de contenido, mediante búsquedas de palabras clave para un tema o página, descubrir temas potenciales relevantes, realizando análisis competitivo.

Linkbuilding

Las estrategias de Linkbuilding son una parte muy importante para el posicionamiento web, el SEO y los resultados de búsquedas de Google SERP.

Según el soporte de ayuda del propio Google el Link Building es un esquema de enlaces que contribuyen a que el PageRank del sitio web mejore y que Google considere que sea un sitio web de calidad.

¿Qué es el PageRank?

El PageRank es el valor que Google asigna a cada página indexada por un motor de búsqueda, ordenándolas de mayor a menor relevancia según sus criterios, basados en algoritmos propios.

En función del número de enlaces que apunten a esas páginas, su relevancia será mayor, de ahí la importancia del linkbuilding.

Google emplea diferentes métodos y algoritmos para detectar prácticas maliciosas que incumplan sus directrices de calidad, penalizando a esos sitios web en su posicionamiento.

Cuanto mayor sea la calidad del sitio web mejor será su posicionamiento.

¿Qué son comportamientos maliciosos?

Principalmente aquellos que manipulen maliciosamente los enlaces a sitios web sin que éstos tengan una verdadera intención de querer enlazarlos, o que existan fines comerciales o puramente lucrativos, por ejemplo;

⛔ La compra o venta de enlaces, intercambio económico, de bienes o servicios por enlaces, publicaciones, artículos.

⛔ Intercambio excesivo de enlaces.

⛔ Comercialización de artículos a gran escala, campañas de publicación de invitados con enlaces de texto de anclaje y excesivas palabras clave.

⛔ Uso de programas o servicios automáticos de creación de enlaces a un sitio web.

⛔ Acuerdos comerciales en los que incluyan en sus condiciones la necesidad de incluir enlaces, prohibiendo al propietario del contenido que pueda usar métodos de bloqueo de PageRank (nofollow).

Ejemplos de enlaces artificiales en páginas web;

⚠️ Anuncios de texto que manipulan el PageRank.

⚠️ Anuncios de publicidad en los que el pago se realiza mediante artículos que contienen enlaces que manipulan el PageRank.

⚠️ Enlaces de texto de anclaje en artículos o comunicados de prensa.

⚠️ Enlaces a sitios o directorios de poca calidad.

⚠️ Enlaces de palabras clave de baja calidad que se insertan en las páginas.

⚠️ Enlaces distribuidos en pies de páginas o plantillas de varios sitios web.

⚠️ Comentarios en foros con enlaces optimizados.

(*) Los enlaces de publicidad de pago (PPC) que no transmitan autoridad ni ventajas de PageRank al comprador de los anuncios, no infringen las directrices de buenas prácticas.

Se recomienda añadir el atributo rel=»nofollow» a la etiqueta <a>.

Redirigir los enlaces a páginas que tengan bloqueados con archivos robots.txt.

¿Cuáles son las directrices calidad de buenas prácticas?

Lo que NO se debe hacer;

✳️ Contenido generado automáticamente.

- Texto que no tiene sentido lógico al leerlo pero que contiene palabras clave para las búsquedas.

- Texto traducido automáticamente sin revisarlo para su posterior lectura.

- Textos generados automáticamente, a partir de feeds RRS o resultados de búsqueda.

- Texto generado a partir de otras publicaciones de otras páginas web, sin un valor añadido.

✳️ Redireccionamientos engañosos

- Redirigir al usuario a un destino distinto del que se muestra al motor de búsqueda.

- Mostrar un contenido a usuarios de equipos de escritorio y otro distinto a usarios de móviles mediante redireccionamientos.

✳️ Esquemas de enlaces (Linkbuilding): que pueden afectar negativamente el posicionamiento;

- Compra o venta de enlaces o intercambio económico de enlaces por artículos y publicaciones.

- Intercambio escesivo de enlaces entre páginas web.

- Comercialización de artículos con enlaces de texto de anclaje y muchas palabras clave.

- Uso de programas automatizados para el envío masivo de enlaces.

- Anuncios de texto que intenten manipular el PageRank.

- Anuncios en los que el pago se realiza mediante publicaciones que incluyen enlaces cuya intención es la de manipular el PageRank.

- Enlaces con textos de anclaje en comentarios de publicaciones, comunicados de prensa o foros.

- Enlaces que redirigen a textos de poca calidad, pies de páginas o plantillas.

- Enlaces con excesivas palabras clave o de baja calidad.

✳️ Encubrimiento (Cloaking)

- Presentar a los motores de búsqueda y a los usuarios contenidos distintos.

✳️ Texto y enlaces ocultos

- Utilizar textos en blanco sobre fondos blancos para ocultar palabras clave.

- Incluir textos detrás de imágenes, usar CSS para incluirlo fuera de pantalla.

- Utilizar tamaño de la fuente cero.

- Ocultar el enlace en un solo carácter.

✳️ Páginas puerta

- Páginas creadas y destinadas a obtener una buena posición en los resultados de búsqueda.

- Páginas o nombres de dominios orientadas a regiones concretas.

- Páginas generadas para dirigir al visitante a una parte relevante de la página.

- Páginas similares con el fin de aglutinar resultados en el posicionamiento.

✳️ Contenido copiado

- Contenido copiado sin añadir contenido original ni valor añadido o utilizando sinónimos modificando ligeramente el original.

- Reproducir feeds de contenido sin organización ni sentido lógico, insertando contenido sin valor añadido.

✳️ Programas de afiliados

- Enlaces de afiliados con textos de descripciones copiados y sin valor añadido.

- Categoría de productos que no estén relacionados con la página original.

- Comunidad con intereses afines al producto o servicio.

- Contenido relevante y actualizado.

✳️ Uso excesivo de palabras clave.

✳️ Creación de páginas con comportamiento malicioso

- Cambio o manipulación de ubicación de contenido de la página, elementos emergentes.

- Inclusión de archivos no desados en una descarga que solicite el usuario, instalación de software malicioso.

- Realizar cambios de navegación del usuario o preferencias de búsqueda sin notificar previamente al usuario y sin su consentimiento.

✳️ Directrices para spam generado por usuarios

- Cuentas y publicaciones fraudulentas en host, cadenas de foros o comentarios en blogs.

Plataformas de linkbuilding

Las plataformas de linkbuilding son una estrategia Seo Off Page y una manera de monetizar los sitios web, mediante la compra venta de enlaces y artículos patrocinados.

¿Qué es Linkbaiting?

Es la técnica Seo que consiste en crear un buen contenido lo suficientemente interesante para captar la atención del usuario, para que éste lo comparta de forma voluntaria.

Este contenido puede tener diferentes formatos, vídeos, artículos, imágenes, aplicaciones o cualquier otro elemento que de verdad sirva de ayuda al usuario, resolviendo una duda, cuestión o problema.

Y lo comparta de forma natural proporcionando al sitio web con un mayor número de enlaces.

Blockchain vs PageRank de Google

Me ha parecido interesante incluir un apartado sobre el Blockchain o Cadenas de Bloques, ya que gira en torno a un mismo sistema, como se estructura la información de los datos para su posterior uso, clasificación y gestión.

¿Qué es el Blockchain o Cadena de bloques?

Blockchain es una estructura de cadenas de datos de información, a los que se les añade informaciones relativas a otros bloques de la cadena anterior, en una línea temporal.

De manera que mediante técnicas criptográficas, la información contenida en un bloque puede ser rechazada o editada, modificando los datos de los bloques posteriores.

Esta propiedad permite que la estructura de datos blockchain puede actuar de base de datos pública no relacional que contenga un histórico irrefutable de información.

Es posible alcanzar un consenso sobre la integridad de los datos por parte de todos los participantes de la red sin necesidad de recurrir a una entidad de confianza que centralice la información.

Por ello se considera una tecnología en la que la «verdad» (estado confiable del sistema) es construida, alcanzada, satisfecha y fortalecida por los propios miembros; incluso en un entorno en el que exista comportamiento malicioso dado que, en teoría, para comprometer los datos, un atacante requeriría de una mayor potencia de cómputo y presencia en la red que el resultante de la suma de todos los restantes combinados.

Por éstas razones, la tecnología blockchain es especialmente adecuada para escenarios en los que se requiera almacenar de forma creciente datos ordenados en el tiempo, sin posibilidad de modificación ni revisión y cuya confianza pretenda ser distribuida en lugar de residir en una entidad certificadora.

Este enfoque tiene diferentes aspectos:

- Almacenamiento de datos

- Transmisión de datos

- Confirmación de datos

Artículo de interés;

Qué es blockchain: la explicación definitiva para la tecnología de moda

Similitudes entre los algoritmos PageRank y Blockchain

Artículos de interés;

La patente anti-spam de Google: link graph y distancia de enlaces

Why Blockchain Could (One Day) Topple Google (en inglés)

Por qué Blockchain podría (un día) derrocar a Google.

Blockchain es la única tecnología informática que comparten las grandes empresas web como Google y Facebook. Si se pueden ofrecer los mismos servicios a través de un backend de blockchain, ¿por qué los usuarios necesitan un repositorio centralizado como Google? Por este motivo, blockchain es la disciplina de la informática actual con el potencial de derrocar al propio imperio de Google…

Common Search: The open source project bringing back PageRank (en inglés)

Búsqueda común: el proyecto de código abierto que devuelve el PageRank

El columnista JR Oakes explica Common Search, una gran herramienta de código abierto para comprender cómo funcionan los motores de búsqueda, que tiene una joya oculta para aquellos de nosotros que no podemos ver nuestra puntuación de PageRank…

Common Crawl’s First In House Web Graph – Common Crawl (en inglés)

El primer gráfico interno de Common Crawl.

Nos complace anunciar el lanzamiento de un gráfico web a nivel de host de los últimos rastreos mensuales (febrero, marzo, abril de 2017). El gráfico consta de 385 millones de nodos y 2.5 mil millones de aristas…

Teniendo en cuenta lo expuesto, han quedado claras algunas cuestiones;

✅ El LInkbuilding es una técnica de enlazado entre diferentes sitios web con el fin de transmitir autoridad a un dominio.

✅ Las prácticas utilizadas para llevarlo a cabo dista de lo que son las buenas prácticas establecidas por Google.

✅ «El contenido es el Rey» y el usuario su dueño (Manu Duque).

✅ El orden de importancia para Google; Enlaces, Contenido y Rankbrain.

✅ El Linkbaiting es el bueno de la película.

✅ No hay Linbuilding bueno.

Ejemplos reales y casos prácticos de Linkbaiting

Caso 1: Análisis del linkbuilding echándole morro

A través de este artículo, Rubén Alonso, pidió de manera abierta a otros blogers que enlazaran a su web, de forma clara y directa.

Este es un ejemplo de Linkbuilding, una mezcla de las diferentes versiones, o dicho de otra forma, una manera diferente de contactar con otros blogs que pudieran estar interesados en intercambiar enlaces.

¿Qué lo hace diferente? la manera en que se produce, sin ocultar nada de forma abierta e interesada, no de manera soterrada y por la trastienda, como se suele hacer.

He querido añadir este ejemplo como algo diferente, una manera de hacer las cosas que se sale de lo habitual y que invita a participar, colaborar y querer beneficiarse mutuamente.

Caso 2: Curso de Diseño y Programación Web

Bextlán. Este es un sitio web en el que poder realizar Cursos de Diseño y Programación Web de manera gratuita, también de pago, pero los cursos que tiene gratuitos son de mucha calidad, muy prácticos y útiles.

Conocí estos cursos después de matricularme en un centro de formación para aprender HTML5, CSS3, PHP y Javascript, y abandonarlo al poco tiempo por la falta de profesionalidad y lo poco que me estaba aportando.

Buscando información y tutoriales di con estos cursos, aprendí HTML y CSS de forma gratuita, después de haberme gastado un dineral en el «Master» del que no aprendí nada.

¿Cómo es esto? Cursos gratuitos en Tutoriales de youtube que te enseñan lo mismo o mejor que cualquier Master de cualquier centro de formación.

Un claro ejemplo de contenido de valor muy útil que no dudarás ni un segundo en compartir, recomendar, enlazar y por qué no, pagar por cualquier otro curso.

Caso 3 : La guía en español de iniciación al Link Building más exhaustiva (versión 1.0)

Cráneo Previlegiado es una agencia especializada en la gestión de campañas de link building, cuyo objetivo es conseguir enlaces para mejorar el posicionamiento orgánico, mediante el SEO, SEO off page.

Realizaron una guía de iniciación al linkbuilding en la que exponen todas las técnicas más efectivas para realizar campañas de linkbuilding, una guía completísima de más de 85 páginas totalmente gratuita.

Aquí la puedes descargar; «La guía en español de iniciación al Link Building».

«Link Building vs Contenido»

Según Google:

Ha quedado claro que para Google, todo lo que no sea contenido de calidad, original, genuino, que aporte valor al usuario, no lo considera contenido que merezca la pena ser posicionado, si además es enlazado de forma honesta sin ninguna intención nada más que la de compartir contenido de valor, acabará dando sus recompensas.

Según los SEOs:

Por muy bueno que sea tu contenido, jamás lograrás posicionar un contenido en los primeros puestos si no es a través de enlaces, de la manera que sea, pero con enlaces de autoridad hacia tu sitio web.

Según el usuario:

Quiero el mejor contenido que me puedas ofrecer google para una búsqueda concreta, me da igual si el sitio web compra enlaces, los vende o su contenido no es el mejor de todos los que hay, porque no me voy a enterar.

¿Entonces? ¿Google, de qué parte estás?

La única certeza es que, según su algoritmo y demás factores de posicionamiento, Google interpreta y establece unas prioridades respecto a otras, determina qué contenido tiene que ofrecer al usuario según su búsqueda y cual es el mejor.

¿Qué es User Search Intent?

La intención de búsqueda de un usuario es la información que ese usuario desea encontrar en un contenido relacionada con la keyword utilizada.

¿Que son blogs de referencia en el mundo del Seo?, ¿Que tienen miles de visitas? También, pero lo que se intenta destacar es qué tienen en común para obtener ese valor.

Una de las características principales por lo que destacan es en el contenido, el contenido de calidad, en realidad su contenido no está basado en Keyword research super elavorados, en estudios de keywords o en técnicas de linkbuilding, entonces, ¿por qué tienen tan buena respuesta de usuario?

Se basan principalmente en desarrollar un contenido que satisface la búsqueda de información del usuario, contenido de valor, útil y que cubre las necesidades del usuario.

Aparecen términos como Dwell (tiempo transcurrido en el contenido hasta que vuelves al buscador) y Pogo sticking (vuelta al buscador y entrar en otro contenido).

¿Cómo responder bien la intención de búsqueda del usuario?, ofreciendo el mejor contenido posible para cada búsqueda.

¿Cómo sé si estoy ofreciendo exactamente lo que el usuario necesita? de eso se encarga google, nosotros «solo» tenemos que ayudarle y centrarnos en realizar contenido específico, útil y de calidad que se ajuste a la necesidad específica para las búsquedas que pueda realizar nuestro usuario o cliente potencial.

Dicho así no parece complicado, y no debería serlo si realmente damos con la tecla para cada caso y situación específica, se necesita conocer en profundidad quien es tu cliente o usuario potencial, qué necesita, cómo lo busca, qué le estás ofreciendo, qué está ofreciendo tu competencia y si puedes mejorar su oferta.

Para conocer la intención de búsqueda del usuario necesitas conocer al usuario y en qué momento de compra se encuentra, para ello hay que analizar;

Tipos de palabras clave para intenciones de búsqueda:

- Informativas: quiere obtener información sobre un tema.

- Navegacionales: llega a la web, artículo a través de Google o directamente desde la marca.

- Informativas – transaccionales: busca información pero con la intención final de comprar.

- Transaccionales: busca el producto con intención de compra.

Intención de búsqueda durante proceso de venta en el embudo de conversión:

- Descubrimiento, necesidad

- Interés, consideración, información de opciones

- Intención, valorar opciones

- Decisión; de compra

Etapas en el embudo de conversión:

- TOFU – Top of the funnel; desconocimiento marca, producto, necesidad

- MOFU – Middle of the funnel; consideración, búsqueda información con intención de compra, comparativas.

- BOFU – Botton of the funnel; decisión final de compra.

fuente; Intención de búsqueda en Seo – Useo

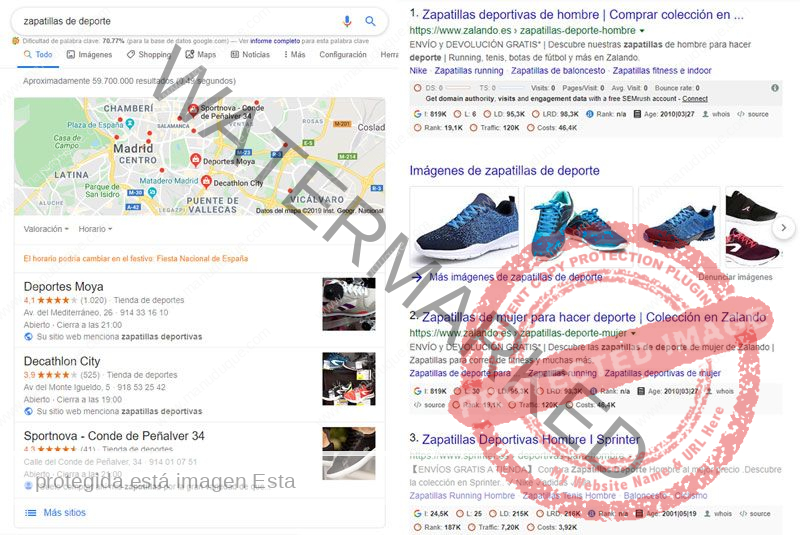

Cómo enfocar la intención de búsqueda del usuario o query es la clave para desarrollar los contenidos que se van a ofrecer, entendiendo la query como la petición del usuario, pero, ¿cómo sabemos que resultados de búsqueda va a mostrar google según cada query?, observando los resultados que ofrece en las SERPs (Search Engine Results Page), por ejemplo;

Para la query «zapatillas de deporte» google muestra estos resultados;

Entiende que son keywords transaccionales, con intención de compra, el usuario está considerando la compra de unas zapatillas de deporte y ofrece diferentes resultados con diferentes establecimientos para la realizar la compra.

No muestra contenido donde se explique qué son las zapatillas de deporte y para qué sirven, que serían las keywords informativas, por lo tanto interpreta que queremos comprar unas zapatillas de deporte, pero todavía no tenemos decidido cuales.

Si realizamos otra búsqueda con la query «intención de búsqueda del usuario», google entiende que es una keyword informativa y buscamos información sobre qué es la «intención de búsqueda del usuario», y muestra diferentes post con contenido donde se explica qué es.

A partir de aquí solo queda que el usuario haga click en alguno de los resultados ofrecidos por google, normalmente el primer resultado se suele llevar la mayoría de los clicks, y normalmente suelen ser resultados de pago, anuncios.

Si el usuario decide hacer click en cualquiera de los resultados de búsqueda orgánicos, google comprobará si ese resultado responde a la query del usuario, a través de diferentes métricas, como el tiempo de permanencia en la página, que el usuario no salga nada más entrar, que haga click en los enlaces internos del artículo, que permanezca en el sitio web.

Y una serie acciones que determinan para google que el usuario ha tenido una buena respuesta de usuario y ha conseguido satisfacer su duda o necesidad.

Una vez se haya conseguido aparecer en las SERPs es necesario que la relación entre el número de veces que se muestre el resultado y las veces que el usuario hace click en ese resultado, sea un porcentaje alto, denominado CTR (Click Through Ratio), a mayor número de clicks mejor CTR, a mejor CTR mejor posicionamiento.

Hay tres factores principales que destacan en las búsquedas y la intención de búsqueda del usuario;

- Aparecer en la primera página de las SERPs con resultados que respondan a la query del usuario

- CTR elevado

- Respuesta de usuario satisfactoria.

Para determinar las intenciones de búsqueda de los usuarios google emplea patrones, identifica patrones para segmentar los datos, divide las búsquedas en 6 grupos según la intención de búsqueda;

- Know; saber, investigar

- Know simple; encontrar un dato concreto, específico

- Do; hacer algo, download descargar algo, buy comprar un producto, obtain obtener el objeto pero no comprarlo, be entertained divertirse, interact interactuar con algún sistema.

- Device action; hacer algo con dispositivos

- Website; búsquedas de navegación, página o sitio concreto

- Visit-in-person; buscar direcciones, negocios cerca de una ubicación concreta

Según los patrones de búsqueda se establecen diferentes funcionalidades en las SERPs (SERP Features);

- Fragmentos destacados (feature snnipets)

- Noticias destacadas

- Módulos Adwords

- Imágenes

- Google Shopping

- Vídeos

Intenciones de Búsqueda y Funcionalidades

Tipos de funcionalidades en las SERPs en relación a la intención de búsqueda;

fuente; Seo moderno: así funciona Google (Juan González en Blogger3.0)

Ejemplos de respuesta a la intención de búsqueda del usuario mostrados por google son los rich results (rich snippets) o fragmentos enriquecidos, resultados que ofrecen información complementaria, que se realiza a través de los datos estructurados en lenguaje schema.org.

Aquí se pueden ver los datos de un estudio realizado sobre productos de todo tipo e intenciones de búsqueda informativas, transaccionales, comerciales y navegacionales.

Cómo realizar los flujos de trabajo para cada intención de búsqueda dependiendo del momento de la fase del embudo de conversión.

fuente; Google ha dejado de ser un buscador – Iñaki Huerta

Artículo de interés;

Intención de búsqueda en SEO – USEO.

Los estudios de palabras clave tienen que estar basados en keywords que traigan tráfico cualificado, que convierta, no sirve de nada tener mucho tráfico si no se producen conversiones.

Realizar un estudio de contenidos analizando qué tipo de clientes o usuarios tiene el negocio, la fase del embudo de ventas en el que se encuentran y resolver las dudas o necesidades que tienen en cada uno de las fases.

Es necesario medir los resultados, comprobar si nuestros contenidos están cumpliendo con los objetivos, no olvidemos que el objetivo principal de google y sobre todo el nuestro es que la satisfacción del usuario con su búsqueda a resuelto su necesidad.

O lo que es lo mismo los datos que nos ofrece la tasa de click, el CTR y el dwell time (tiempo de permanencia en el sitio web antes de volver a la página de resultados SERPs).

Aspectos que miden la satisfacción del usuario;

- CTR (porcentaje de clicks / impresiones)

- Tasa de rebote (Dwell time)

- Duración de la visita

- Páginas vistas

Curso de Search Intent – SeoWarriors

Gratuito

Vídeo 1: Ejemplos rápidos e introductorios sobre la Intención de Búsqueda

Vídeo 2: Tipos de query que debes conocer

Vídeo 3: Search Intent según la parte del funnel en la que se encuentra el usuario

Vídeo 4: Keyword research + Search intent

Vídeo 5: Keywords vs intención de búsqueda

Vídeo 6: ¿Cómo saber cuándo entrar y cuándo no entrar en un nicho?

by Dean Romero

Referencias:

- ¿Qué es la intención de Búsqueda del Usuario? – Blogger 3.0

- Embudo de Conversión: Qué es y para qué sirve – Rubén Mañez

- Cómo responder bien a una Query – Blogger 3.0

- Así funciona Google: Seo moderno – Blogger 3.0

- Google ha dejado de ser un buscador – Iñaki Huerta

- Plan de contenidos – USEO

- Cómo afecta el CTR a los cambios de posiciones – USEO

- Seo centrado en el usuario – Mi posicionamiento Web

imagen portada:

www.freepik.es – Vector de Infografía creado por vectorpouch, Plantilla creado por freepik

Estrategias Posicionamiento SEO

Cómo posicionar las Keywords en tu sitio Web.

Para realizar un análisis de Palabras Clave, del propio sitio web y de la competencia hay una herramienta perfecta y además gratuita, con limitaciones pero perfectamente útil para realizar todas estas tareas y sin tener que ser un experto en la materia, es la herramienta SEO PowerSuite.

La propia herramienta cuenta con tutoriales explicativos perfectamente entendibles sin tener unos conocimientos muy extensos sobre Seo, pero si que son necesarios tener conocimientos básicos para poder entender las funciones a realizar.

Esta herramienta se compone de cuatro herramientas;

Rank Tracker;

Monitorización de rankings

Monitorización Geográfica

Herramientas integradas, AdWords Keyword Planner, SEMRush Keyword Discovery, Google Trends, Búsquedas relacionadas de Google, Google Autocomplete, Google Analytics y Search Console

Análisis de palabras Clave prioritarias, volumen de búsquedas mensuales, competencia y eficiencia de palabras clave, dificultad de posicionamiento

WebSite Auditor;

Robot de rastreo auditoría elementos internos y externos

Genera mapa XML Sitemap, archivo robots.txt

Auditoría Seo on-page

Análisis de contenidos

SEO SpyGlass;

Análisis backlinks, enlaces perjudiciales, competidores

LinkAssistant;

Investigación y análisis Linkbuilding

Flujo de trabajo para Seo (SEO PowerSuit)

Búsqueda de Palabras Clave

Hay que empezar planteándose en términos generales que las keywords que vamos a emplear tienen que tener un volumen de búsquedas elevado (determinar según tu mercado y tu competencia), que son keywords específicas y adecuadas relacionadas con nuestro objetivo, y que tengan un nivel de competencia relativamente bajo.

1º Lista de Keywords relevantes y de mayor potencial.

2º Comprobación de ranking de sitio web, motores de búsqueda.

3º Detección problemas sitio web, auditoría interna.

4º Optimizar Landing Page.

5º Eliminación Enlaces perjudiciales.

6º Enlaces de Calidad.

Tutoriales

Introducción

1º Lista de Keywords relevantes y de mayor potencial

Keyword Research

2º Comprobación de ranking de sitio web, motores de búsqueda. Rank Tracker

Rank Tracking

3º Detección problemas sitio web, auditoría interna. WebSite Auditor

Auditoría Web

4º Optimizar Landing Page

Optimización de página

5º Eliminación Enlaces perjudiciales. SEO SpyGlass

Auditoría de Backlinks

6º Enlaces de Calidad. LinkAssistant

Link Building

Esta herramienta es perfecta para cualquier usuario que no tenga los medios de cualquier agencia de marketing digital y quiera indagar en el Seo, en las estrategias de palabras clave, sin necesidad de invertir en medios y herramientas profesionales.

La importancia de poder identificar qué es Seo en marketing digital, cómo desarrollar y diseñar estrategias de posicionamiento web utilizando diferentes palabras clave, cómo posicionar tu sitio web en los distintos buscadores.

Son la clave del Posicionamiento Seo, junto con un buen diseño y una estructura de tu sitio web optimizada determinarán los resultados, que no son otros que satisfacer la búsqueda del usuario, que el usuario encuentre lo que está buscando y pueda satisfacer su duda, información, compra, curiosidad o cualquiera que fuera su necesidad a través de su buscador.

Google actúa en favor del usuario y todo lo que se haga en consonancia a este fin lo premiará en forma de un mejor posicionamiento, mostrándolo en las SERP´s en las primeras posiciones, tanto en los resultados de búsqueda orgánicos como en los de pago, a través de google Adwords.

Curso de SEO

Hay muchos cursos de Seo, de diferentes precios, metodologías, experiencias y utilidades, lo ideal sería hacerlos todos y decidir cual ha sido el mejor, pero eso sería inviable ya que supondría una inversión, que no gasto, muy elevada.

Yo te recomiendo el Curso de Dean Romero;

¿Por qué te recomiendo este Curso de Seo?

Sencillamente, después de haber hecho varios Cursos de Seo, a mí, me parece que es el que mejor enfoca el Seo, desde un punto de vista de alguien que puede no tener experiencia en Seo, como alguien experimentado.

Esto no quiere decir que sea la prueba definita, hay más cursos, mejores y peores.

Lo mejor, probar, experimentar, equivocarse, o no, ver resultados y valorar si ha merecido la pena.

Como todo en SEO, prueba, experimenta, comprueba y si funciona, era eso.

Diferentes tipos de Seo, Black Hat Seo, White Hat Seo, Grey Hat Seo.

Black Hat Seo

Black Hat Seo (sombrero negro en inglés) es el término empleado para denominar el uso de prácticas o técnicas para intentar engañar a Google.

Con el fin de obtener resultados potencialmente adulterados, en los resultados de los motores de búsqueda de las SERP, intentando mejorar su posicionamiento orgánico natural.

Los buscadores avisan de las penalizaciones que pueden sufrir los sitios web y webmasters por el uso de estas técnicas para mejorar los rankings en los buscadores.

Este tipo de técnicas se denominan black hatter y algunas de las características para llevarlo a cabo el black hat Seo son;

Desafíar las normas y reglas de los buscadores

Interrumpir la navegación de los usuarios

Páginas desordenadas, multgitud de palabras clave sin sentido aparente

Malware en el sitio web

White Hat Seo

White Hat SEO son las técnicas empleadas en el posicionamiento orgánico que están dentro de las normas y directrices que marcan los buscadores.

Para ello deben seguir los estándares y recomendaciones de buenas prácticas de los buscadores.

Incluyen que el contenido tiene que ser de calidad, original, útil y que aporte valor al usuario.

Diseño de la web, tanto en frontend (lo que ve el usuario) como el Backend (software, código).

Todo lo que tenga que ver con la experiencia de usuario en su navegación.

Grey Hat Seo

Grey Hat Seo, traducido del inglés (sobrero gris), son las técnicas empleadas para mejorar o acelerar las prácticas del white hat Seo pero sin llegar a incumplir las reglas y directrices de google.

Estas acciones se llevan a cabo a través de prácticas manuales y no naturales-

Todo lo que tenga que ver con el contenido de calidad, mejora notablemente las posibilidades de aparecer en los primeros resultados de búsqueda.

Como la extensión adecuada, la semántica o temática relacionada, el uso de la cantidad palabras clave adecuada, contenido estructurado y ordenado, elementos multimedia.

Enlazado artificial teniendo en cuenta la temática relacionada, la periodicidad con que se realiza, desde donde se realiza, los anchor text con que se realizan, y una serie de aspectos técnicos que están entre el white hat seo y el black hat seo.

Referentes del sector SEO;

Iñaki Tovar

Equipo Webpositer.

Consultor, Formador en Marketing Digital, Estrategias Online.

Seomental

María Sánchez

Equipo Webpositer

Marketing Online & Consultora CRO.

Conversion Master

Marta Romera

Consultora SEO en Internet República

Internet República

Lola Gallent

Consultora SEO en Internet República

Internet República

Iñaki Huerta

IKAUE Marketing de Optimización

Ikhuerta.com

Daniel Pinillos

Co-Founder FunnelPunk. Consultor SEO y CRO

Daniel Pinillos

Viki Becerra

Head of SEO en LeadTech

Sico de Andrés

Consultor SEO y Organizador del SEOonthebeach

Sergio Simarro

Chief Revenue Officer en Magnificro

Sergio Simarro

Alyona Dvornikova

Responsable de SEO España en American Express

Mj Cachón

Consultora SEO y Marketing Online

MJ Cachón

José Márquez

Co-fundador de Prensarank y Linkapress entre otros proyectos.

Prensarank Linkapress

Miguel Ángel Almela

Prensarank

Cantinamarketera

Pepe Moral

Digitalcontent – Administrador y CFO

Digital Content

Álvaro Sáez (Chuiso)

Black Hat, SEO y monetización

Chuiso

Luis Villanueva

SEO Manager en Webpositer

Luis Villanueva

Eventos SEO

- Congreso SEO Profesional (Madrid) – Junio

- Congreso Web (Zaragoza) – Junio

- Seonthebeach (La Manga, Murcia) – Junio

- SEOPlus (Alicante) – Julio

- Clinic SEO (Barcelona) – Octubre

- Congreso SEO para Seos (Alicante) – Octubre

- Ensalada SEO (Zaragoza) – Noviembre

- Evento SEO (Madrid) – Noviembre

Te puede interesar;

- Inteligencia Artificial IA & SEO

- Cursos de SEO Técnico: WPO, Desarrollo web y Programación

- Plataformas de Likbuilding para Comprar Enlaces

- Cómo hacer un Keyword Research

imagen portada; Vector de Personas creado por freepik, Vector de Tecnología creado por pikisuperstar – www.freepik.es